Yapay zeka destekli sohbet robotları zekamızı nasıl etkiliyor?

Büyük dil modelleri giderek daha fazla bilişsel görevi üstlenirken, araştırmacılar bu zihinsel dış kaynak kullanımının bir bedeli olduğunu uyarıyor.

Araştırma bilimcisi Nataliya Kosmyna stajyer ararken, aldığı kapak mektuplarının şüphe uyandıracak kadar birbirine benzediğini fark etti. Mektuplar uzundu, özenle yazılmıştı ve giriş bölümünden sonra genellikle onun çalışmalarıyla soyut ve keyfi bir bağlantıya atlıyorlardı.

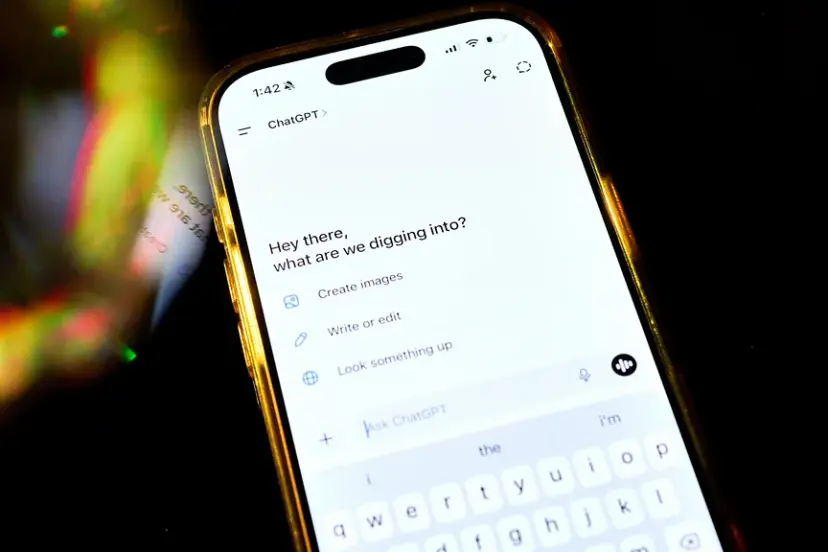

Başvuranların mektupları yazmak için büyük dil modelleri (LLM'ler) – ChatGPT, Google Gemini ve Claude gibi sohbet robotlarını çalıştıran bir yapay zeka türü – kullandıkları ona açıkça belliydi.

Aynı zamanda, Massachusetts Teknoloji Enstitüsü'nde (MIT) kampüs dersleri sırasında, insanlar ve bilgisayarlar arasındaki etkileşimi inceleyen Kosmyna, birçok öğrencinin birkaç yıl öncesine kıyasla içeriği daha kolay unuttuğunu fark etti.

LLM'lere olan bağımlılığın artmasıyla birlikte, bunun öğrencilerinin bilişsel işlevlerini etkileyebileceğine dair bir önsezisi oldu ve konuyu daha iyi anlamaya çalıştı

Kosmyna gibi araştırmacıların endişesi, yapay zekaya fazla bağımlı hale gelmemizin, kullandığımız dili ve hatta temel bilişsel görevleri yerine getirme yeteneğimizi etkileyebileceği yönündedir. Yapay zekaya yapılan bu “bilişsel yük devri”nin zihinsel yeteneklerimiz üzerinde zararlı bir etkiye sahip olabileceğini gösteren araştırmaların sayısı giderek artmaktadır. Bunun sonuçları endişe verici olabilir ve hatta bilişsel gerilemeye katkıda bulunabilir.

ChatGPT grubu, beyin aktivitesinde belirgin bir azalma gösterdi – aktivite %55'e varan oranda azaldı

Kullandığımız araçların düşünme şeklimizi değiştirebileceği iyi bilinmektedir. Örneğin, internetin ortaya çıkmasıyla birlikte, eskiden derinlemesine araştırma gerektiren görevler, arama kutusuna basit bir sorgu girilerek bulunabilir hale geldi. Arama motorlarının kullanımı arttıkça, araştırmalar detayları hatırlama olasılığımızın azaldığını ortaya koydu; buna “Google etkisi” adı verildi. (Bazıları ise internetin, beynimizi diğer görevlere ayırmamızı sağlayan bir dış bellek sistemi işlevi gördüğünü savunuyor.)

Ancak, düşünme işlerimizin daha fazlasını LLM'lere ve diğer yapay zeka türlerine devrettikçe, bunun hafızamız ve problem çözme becerilerimiz üzerindeki etkilerinin daha da kötüleşebileceğine dair endişeler artıyor. Yapay zeka araçları ikna edici şiirler yazabilir, finansal tavsiyelerde bulunabilir ve arkadaşlık edebilir. Öğrenciler de kendi çalışmalarını giderek daha fazla yapay zeka araçlarına devrediyor.

Araştırmalar, gençlerin yapay zeka kullanımının eleştirel düşünme gibi temel bilişsel beceriler üzerinde yaratabileceği olumsuz etkilere karşı özellikle savunmasız olabileceğini zaten göstermiştir. Ancak Kosmyna, potansiyel etkileri daha derinlemesine incelemek istedi.

Zihinsel çabanın azalması

O ve MIT Medya Laboratuvarı’ndaki meslektaşları, kısa denemeler yazmaları için 54 öğrenciyi seçti ve onları üç gruba ayırdı. Bir gruba ChatGPT’yi kullanmaları talimatı verildi. İkinci grup, yapay zeka tarafından oluşturulan özetler devre dışı bırakılmış halde Google aramasını kullanabilirdi. Üçüncü grup ise herhangi bir teknoloji kullanmadı. Her öğrencinin beyin dalgaları, çalışırken ölçüldü.

Kompozisyon konuları kasıtlı olarak açık uçluydu, yani görev için çok az araştırma gerekiyordu; sadakat, mutluluk veya günlük yaşam seçimlerimizle ilgili sorular içeren yönlendirmeler vardı.

Sonuçlar henüz bir bilimsel dergide yayınlanmadı, ancak Kosmyna'ya göre yine de göz açıcıydı. Kendi zihinlerini kullananların beyni “ateşlenmişti” ve beynin birçok bölgesinde yaygın bir aktivite gösteriyordu, diyor. Sadece arama motorunu kullanan grup, beynin görsel bölgelerinde hala güçlü bir aktivite sergiledi, ancak ChatGPT grubu belirgin şekilde daha az beyin aktivitesi gösterdi – bu aktivite %55'e kadar azaldı.

Kosmyna, “Beyin uykuya dalmadı, ancak yaratıcılık ve bilgi işlemeyle ilgili bölgelerde çok daha az aktivite vardı” diyor.

ChatGPT, insanların hafızalarını da etkiledi. Denemelerini teslim ettikten sonra, AI grubundaki kişiler denemelerinden alıntı yapamadılar ve birçoğu, çalışmalarının kendilerine ait olmadığını hissetti. Diğer araştırmalar da, insanların ChatGPT gibi AI araçlarını kullandıklarında bilgileri saklama ve hatırlama becerilerinin azaldığını göstermiştir.

Bu bulgular hâlâ hakem değerlendirmesinden geçiyor olsa da, diğer araştırmalardan elde edilen sonuçlarla örtüşüyor. Pennsylvania Üniversitesi’ndeki araştırmacılar tarafından yürütülen bir çalışma, bazı kişilerin üretken yapay zeka sohbet robotlarını kullanırken “bilişsel teslimiyet” olarak adlandırdıkları bir durum yaşadığını ortaya koyuyor. Bu, söz konusu kişilerin yapay zekanın söylediklerini çok az sorgulayarak kabul etme eğiliminde oldukları ve hatta kendi sezgilerinin önüne geçmesine izin verdikleri anlamına geliyor.

Benzer etkiler, yapay zeka sohbet robotlarının dünyası dışında da, hatta hayat-memat meselelerinde bile görülebilir. Yakın zamanda yapılan çok uluslu bir araştırma ekibi, üç ay boyunca kolon kanseri taraması için bir yapay zeka aracı kullanan tıp uzmanlarının, daha sonra bu araç olmadan tümörleri tespit etmede daha başarısız olduklarını buldu.

Kosmyna, işleri yapay zekaya devretmenin, özgün eserlerin ortaya çıkmasını sağlayan yaratıcılığın büyük bir kısmını kaybetme riskini de beraberinde getirdiğini uyarıyor. Kosmyna, araştırmasına katılan öğrencilerin ChatGPT ile yazdıkları kompozisyonların birbirine çok benzediğini ve bunları değerlendiren öğretmenler tarafından “ruhsuz”, özgünlükten ve derinlikten yoksun olarak nitelendirildiğini belirtiyor. “Öğretmenlerden biri, kompozisyonlar o kadar benzerdi ki, öğrencilerin yan yana oturup yazmadıklarını sordu.”

Bu tür araştırmalar, LLM'lerin beyin üzerinde yaratabileceği kısa vadeli etkileri ortaya koyarken, uzun vadeli etkiler çok daha belirsizdir. Kosmyna ve meslektaşlarının yaptığı çalışma bu konuda bir fikir veriyor. İlk çalışmadan dört ay sonra öğrencilerden başka bir deneme yazmalarını istediler, ancak bu sefer ChatGPT'yi kullanmış olanlara LLM desteği olmadan çalışmaları söylendi. Beyinlerindeki sinirsel bağlantı, tersi yönde geçiş yapanlara göre daha düşüktü; bu da belki de başından beri konularla yeterince ilgilenmediklerini gösteriyor olabilir.

Bilişsel gerileme

Bununla birlikte, “Robot Proof” kitabının yazarı olan hesaplamalı sinirbilimci Vivienne Ming, büyük dil modellerinin (LLM'ler) düşünme sürecine yardımcı olacak olumlu bir araç olabileceğini, ancak bunun ancak zihinsel görevlerimizi bu modellere devrederek onlara bağımlı hale gelmediğimiz takdirde mümkün olacağını belirtiyor. Ming, çoğu insanın bu teknolojiyle bu şekilde etkileşime girmediğinden endişe duyuyor.

Bu görüşünü, kitabı için yaptığı araştırmaya dayandırıyor. Ming, bu araştırma sırasında Berkeley Üniversitesi'ndeki bir grup öğrenciden petrol fiyatı gibi gerçek dünyadaki sonuçları tahmin etmelerini istedi. Katılımcıların çoğunun sadece yapay zekaya sorup cevabı kopyaladığını gördü.

Ming, beyinlerinin gama dalga aktivitesini – bilişsel çabanın bir göstergesi – ölçtü ve çok az aktivasyon olduğunu gördü. Araştırması henüz yayınlanmadı, ancak Ming, bulgularının ileriki çalışmalarda da doğrulanması halinde bunun uzun vadeli sonuçları olabileceğinden endişe ediyor. Örneğin, başka araştırmalar zayıf gama dalga aktivitesini ilerleyen yaşlarda bilişsel gerilemeyle ilişkilendirmiştir.

“Bu gerçekten endişe verici,” diyor Ming. “Eğer bu, insanların bu sistemlerle etkileşim kurmasının doğal bir yolu ise – ve bunlar zeki çocuklar – bu kötü bir durum.” Derin düşünme, diyor, bizim süper gücümüzdür. “Eğer bunu kullanmazsak, bilişsel sağlık açısından uzun vadeli sonuçları oldukça ciddi olacaktır.”

Bunun nedeni, LLM'lere güvendiğimizde çok az bilişsel çaba gerektirmesidir, diye ekliyor Ming; oysa sağlıklı bir beyin için tam da buna ihtiyaç vardır.

Ancak katılımcıların küçük bir kısmı – %10’dan azı – farklı bir yaklaşım sergiledi ve yapay zekayı, daha sonra kendileri analiz ettikleri verileri toplamak için bir araç olarak kullandı. Bu kişiler diğer katılımcılara göre daha isabetli tahminlerde bulundu ve beyinlerinde daha güçlü bir aktivite sergiledi.

Uzun vadeli beyin sağlığı için kendimizi zorlamaya devam etmeliyiz

Neredeyse yirmi yıl önce Ming, 20 ila 30 yıl içinde Google Haritalar'a aşırı bağımlılığımızla doğrudan ilişkili olarak demans oranlarında istatistiksel olarak anlamlı bir artış göreceğimizi öngörmüştü. “Bunu kışkırtıcı bir şekilde söylemek istedim,” diyor Ming. “Yol bulmak için düşünmek zorunda kalmazsanız, bunun tespit edilebilir bir etkisi olacaktır.”

Bu kesin tahminle ilgili elimizde veri olmasa da, üç yıl boyunca 13 kişi üzerinde yapılan bir araştırmaya göre, GPS kullanımındaki artış zamanla uzamsal hafızanın zayıflamasıyla ilişkilendirilmiştir. Başka bir araştırmaya göre ise zayıf uzamsal yön bulma becerisi, Alzheimer hastalığının potansiyel bir belirleyicisi olabilir.

Beynimiz ne kadar aktif olursa, bilişsel gerilemeden o kadar iyi korunacağı açıktır. Ming, LLM'lerin sadece yaratıcılığı azaltmakla kalmayıp, bilişsel işlevlere zarar verebileceğini ve potansiyel olarak demans riskini artırabileceğini söylüyor.

Yapay zeka araçlarının kullanımı arttıkça, bu araçlarla bize zarar vermek yerine fayda sağlayacak şekilde çalışmamız gerekiyor. Ming, nihai hedefin, insanlar ve makinelerin “zor işleri” birlikte üstlendiği bir tür “melez zeka” olabileceğini öne sürüyor. Bununla kastettiği, araçların bizim yerimize soruları cevaplamasına izin vermek yerine, önce kendimiz düşünmemiz ve daha sonra araçları kendimizi zorlamak için kullanmamız gerektiğidir. Kosmyna da buna katılıyor ve önce AI araçları olmadan konuları öğrenerek bir temel oluşturmayı, ardından LLM'leri kullanmayı düşünmeyi öneriyor.

Ming, kendi düşünce yapınızı zorlamak için “nemesis prompt” adını verdiği yöntemi kullanmanızı öneriyor. Bu teknik, bir AI'yı “ömür boyu düşman” veya nemesis olarak davranmaya teşvik edip, ardından fikirlerinizin neden yanlış olduğunu ve bunları nasıl düzeltebileceğinizi ayrıntılı olarak açıklamasını isteyerek çalışır; böylece, AI'nın verdiği cevapları basitçe kabul etmek yerine, argümanlarınızı savunmaya ve geliştirmeye zorlar.

Önerdiği bir başka teknik ise “üretken sürtüşmeye” öncelik vermek ve AI'dan cevap vermek yerine sadece bağlam sağlamasını ve size sorular sormasını istemektir. Bunu, bir AI botunu cevap vermemesi için ince ayarlayarak test ettiğinde, daha fazla kişinin daha fazla ilgi gösterdiğini gördü.

Sonuç olarak, hepimiz “beynimizin sevdiği” bir şey olan bilişsel kısayollara karşı dikkatli olmalıyız, diyor Kosmyna. Açıkçası, uzun vadeli beyin sağlığı için kendimize meydan okumaya devam etmemiz gerekiyor. Zihnimiz, yaratıcılığımız ve bilişsel sağlığımız bu süreçten fayda görecektir.